[프라임경제] 생성형 인공지능(AI) 서비스를 개발·활용하는 기업·기관을 위한 개인정보 처리 기준이 공식 제시됐다.

개인정보보호위원회(이하 개인정보위)는 6일 서울 중구 정동 1928 아트센터에서 열린 '생성형 AI와 프라이버시' 오픈 세미나에서 '생성형 AI 개발·활용을 위한 개인정보 처리 안내서’를 공개했다.

이번 안내서는 ChatGPT 등 상용 대규모언어모델(LLM) API나 Llama 등 오픈소스 LLM을 미세조정해 서비스를 제공하는 사업자들이 활용 가능하다.

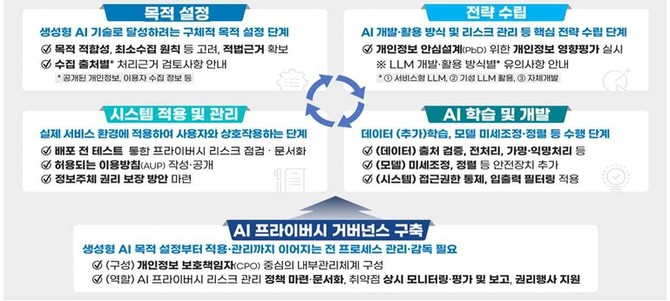

안내서는 생성형 AI 개발·활용 생애주기를 △목적 설정 △전략 수립 △AI 학습·개발 △시스템 적용·관리 등 4단계로 구분하고, 단계별 최소 안전조치를 제시했다. AI 시스템 개발·활용 방식도 △서비스형 LLM 활용 △기성 LLM 활용 △자체 개발 등 유형별로 나눠 법적 기준과 안전성 확보 기준을 명확히 했다.

또 △생성형 AI 학습 시 개인정보 처리의 법적 근거 △리스크 경감 방안 △데이터 오염·탈옥 방지 △AI 에이전트 관리 등 현장에서 불확실성이 높았던 이슈에 대해 정책·집행 사례를 기반으로 구체적 해결책을 담았다. 아울러 AI 에이전트, 지식증류, 머신 언러닝 등 최신 기술 동향과 연구 성과도 반영했다.

이번 안내서는 올 초부터 내부 검토와 외부 전문가 의견 수렴을 거쳐 마련됐다. 이후 'AI 프라이버시 민·관 정책협의회'와 개인정보위 제16회 전체회의를 통해 공개본이 확정됐다.

고학수 위원장은 "명확한 안내서를 통해 실무 현장의 법적 불확실성이 해소되고, 생성형 AI 개발·활용 전 과정에 개인정보 보호 관점이 체계적으로 반영될 것"이라며 "프라이버시와 혁신이 공존하는 정책 기반을 지속 마련하겠다"고 말했다.

--comment--

첫 번째 댓글을 작성해 보세요.

댓글 바로가기