시사위크=박설민 기자 생성형 인공지능(AI)의 영향력은 사회 분야에 막대한 영향을 미치고 있다. 시장조사업체 ‘스태티스타(Statista)’에 따르면, 생성형 AI시장 규모는 2031년 4,000억달러 수준이다. 동기간 컴퓨터(PC) 시장 규모와 맞먹는 수준이다. 5년도 채 되지 않아 수십년 간 사회를 지탱한 PC를 뛰어넘는 것이다.

하지만 기술이 뛰어나다는 것은 그만큼 악용의 소지가 다분하다는 의미다. 실제로 IT업계에서도 생성형 AI로 인한 부작용에 대한 우려가 크다. 특히 ‘사이버 보안’ 문제에 있어 생성형 AI는 새로운 위험 요소로 자리 잡고 있다. 이에 따라 전문가들은 관련 대응 방안 및 기술 고안이 필요하다고 경고한다.

◇ 보안업계 10명 중 8명 “AI가 올해 최대 사이버 보안 위협”

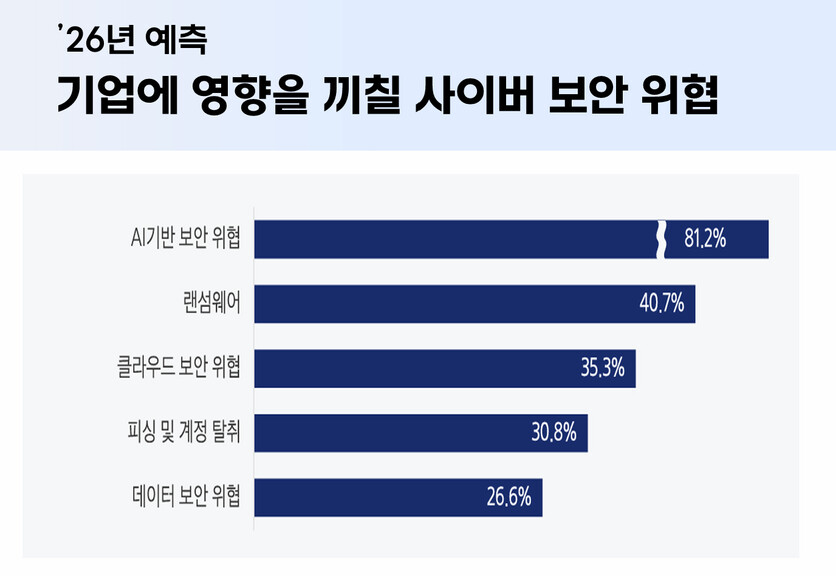

생성형 AI가 새로운 보안 위협 요소가 될 것이라는 전망은 ‘산업계’를 중심으로 나온다. 주목할 것은 ‘삼성SDS’가 발표한 보고서다. 23일 삼성SDS는 지난해 국내외에서 발생한 사이버 보안 이슈를 분석해 2026년 기업에 영향을 끼칠 주목해야 할 5대 사이버 보안 위협을 발표했다.

삼성SDS가 발표한 ‘2026년 5대 사이버 보안 위협’은 △AI 기반 보안 위협 △랜섬웨어 △클라우드 보안 위협 △피싱 및 계정 탈취 △데이터 보안 위협 등이 선정됐다. 삼성SDS는 국내 IT 및 보안 담당 실무자, 관리자 및 경영진 667명을 대상으로 의견을 청취해 5대 위협 요소를 선정했다.

각 문제를 살펴보면 클라우드, 랜섬웨어, 피싱 및 계정 탈취, 데이터 보안은 사실 예전부터 존재했던 문제들이다. 쉽게 말해 IT산업시대가 도래한 이후 자리 잡은 ‘터줏대감’과 같은 보안 문제다. 반면 AI는 이중 가장 ‘최신’ 보안 위협 요소로 분석할 수 있다. 즉, 새롭게 등장한 위험 요소인 만큼 정확한 대응 방안과 보안 기술이 부족할 수 있다는 의미다.

실제로 삼성SDS의 설문조사에서 응답자 81.2%가 AI기반 보안 위협을 올해 기업에 가장 큰 영향을 미칠 사이버 보안 위협으로 꼽았다. AI가 해커 등 인간 공격자의 공격을 받거나 더 나아가 다른 AI 자체에 영향을 받을 수 있다는 것이다. 이 경우 업무 수행 과정을 침해받고 필요없는 명령을 수행하거나 민감 정보를 유출하는 등 문제 발생이 우려된다.

이때 삼성SDS가 예상한 AI 보안 문제의 핵심은 ‘AI에이전트(Agent)’의 도입 및 확산이다. 예상 자율적 업무 수행 주체로 발전 중인 AI에이전트 실행 과정에서 과도한 위임 및 권한 남용을 통해 데이터 유출, 무단 작업, 시스템 손상을 초래할 수 있다는 것이다.

AI에이전트, 즉 ‘AI비서’ 관련 서비스는 개인정보를 다루는 경우가 많다. 예를 들어 AI비서 이용자가 자신의 사적인 정보를 담은 질문을 할 경우, AI알고리즘을 통해 해당 정보가 유출될 가능성이 있다. 실제로 지난 2024년 오픈AI의 ‘챗GPT’에 대해 이탈리아 개인정보보호당국(GPDP)은 1,500만유로(약 256억원)의 벌금을 부과한 바 있다. 오픈AI가 챗GPT를 훈련시키는 과정에서 사용자의 적절한 동의 없이 개인정보를 처리, 정보 제공 의무를 위반했다는 것이다.

◇ AI보안안전, ‘가드레일’ 마련이 핵심 과제

삼성SDS는 이 같은 생성형 AI기반 AI에이전트 사용 시 발생할 수 있는 보안문제를 해결하기 위해선 ‘AI 가드레일’이 필요하다고 강조한다. AI 가드레일은 AI 시스템이 안전하고 신뢰할 수 있는 범위 내에서 동작하도록 하는 제어 기술 및 솔루션이다.

AI 가드레일이라는 용어는 차량용 가드레일에서 유래된 용어다. 일반 가드레일이 차량 주행 중 도로 이탈을 막는 것처럼 AI가 유해하거나 부적절한 콘텐츠를 생성하거나 의도하지 않은 행동을 막는 안전장치 역할을 수행한다는 의미다.

삼성SDS는 “생성형 AI로 인한 보안 문제를 막기 위해서는 AI에 최소 권한을 부여해야 한다”며 “정보의 변경이나 결제 등 민감한 명령 수행 시 AI 가드레일을 통한 실시간 모니터링 및 이상 행위를 탐지하고 차단하며 사용자 승인 과정을 거치도록 해야 한다”고 설명했다.

과학계 역시 AI 가드레일의 설정이 향후 AI 보안 위협에 대응할 수 있는 핵심 장치라고 강조한다. 영국 요크대 연구진은 최근 발표한 보고서 ‘AI GUARDRAILS: CONCEPTS, MODELS AND METHODS’에서 AI 가드레일이 필요한 이유에 대해 AI의 ‘들쭉날쭉한 경계(Jagged frontier)’ 때문이라고 설명했다.

요크대 연구진은 “들쭉날쭉한 경계라는 개념은 AI가 할 수 있는 것과 할 수 없는 것을 구분하는데 사용된다”며 “우리는 AI가 어떤 작업에 있어 사람처럼 일정하고 동일하게 잘 수행해야 한다고 생각하지만 결과는 그렇지 않은데 이것이 들쭉날쭉한 경계”라고 설명했다.

이어 “따라서 AI개발자 및 이용자는 AI모델이 안전하게 수행할 수 없는 작업에 사용되는 것을 막기 위해 어디에 가드레일을 설치해야 할지 알아야 하지만 이는 쉽지 않다”며 “이것이 AI 가드레일에 대한 연구가 필요한 이유”라고 전했다.

AI 가드레일의 중요성이 커지면서 관련 분야에 대한 개념 연구와 기술 시장 성장도 빠르게 이뤄지고 있다. 먼저 관련 기술 시장은 AI 성장과 더불어 급부상하는 추세다. 글로벌 시장조사업체 ‘데이터인텔로(DATAINTELO)’에 따르면, AI 가드레일 기술 시장은 연평균 성장률 21.7%로 2033년 172억달러(약 24조7,680억원)에 달할 전망이다.

삼성SDS는 “기업은 데이터 수집, 학습, 시스템 도입 및 구축, AI 운영, 폐기에 이르는 AI라이프사이클의 각 단계별 위협을 사전에 인식하고 대응해야 한다”며 “정보 유출을 막기 위해 AI에 데이터를 입력하고 응답을 받는 상호작용 과정 및 산출물을 실시간으로 모니터링하고 차단하는 AI 가드레일 적용이 필요하다”고 조언했다.

Copyright ⓒ 시사위크 무단 전재 및 재배포 금지

--comment--

첫 번째 댓글을 작성해 보세요.

댓글 바로가기